LLMとは何か? ― Large Language Model の本当の意味

LLM(Large Language Model)は、単なる会話AIではありません。

巨大なデータで学習されたニューラルネットワークが、

入力されたトークン列から次のトークンを予測する仕組みです。

本ページは、SNS #31 の受けとして、

Large / Language / Model の意味と構造を整理します。

TL;DR

- Large:数千億規模のパラメータ、巨大GPU計算基盤

- Language:自然言語だけでなくコード・数式・記号もトークンとして扱う

- Model:入力から次のトークンを確率的に予測するニューラルネットワーク

- LLMの本質は Next Token Prediction

01 — What is a Large Language Model?

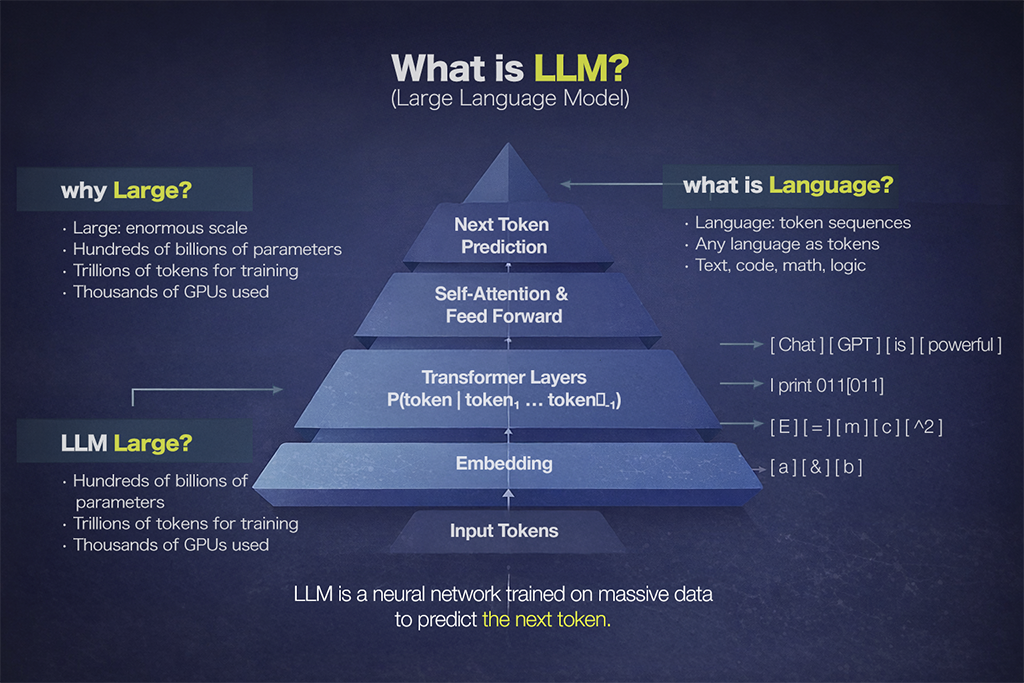

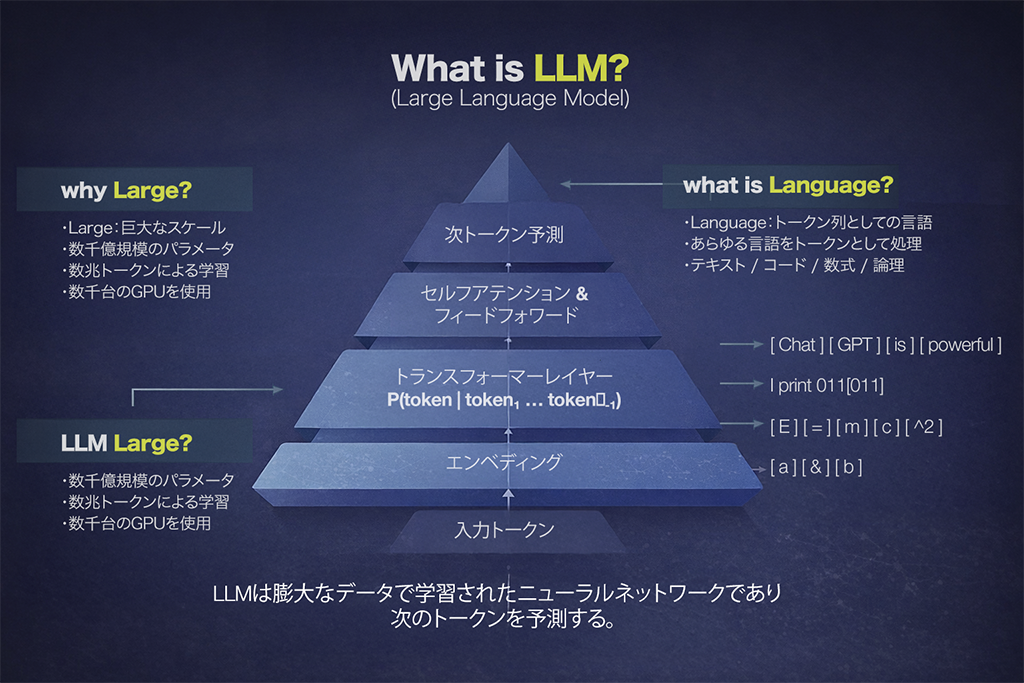

LLM(Large Language Model)は、巨大なデータで学習された トランスフォーマー型ニューラルネットワークです。 入力されたトークン列を処理し、次のトークンを予測することで テキスト・コード・推論などの出力を生成します。

What is a Large Language Model?

LLM(Large Language Model)の基本構造

LLMの本質は Next Token Prediction です。

入力されたトークン列をもとに、次に最も確率の高いトークンを予測します。

会話AIのように見えても、内部ではこの予測処理が繰り返されています。

02 — Large / Language / Model

LLMという言葉は、3つの要素で構成されています。 Large、Language、Model。 この3つを分解すると、LLMの役割と限界が理解しやすくなります。

巨大なモデル規模

- 数十億〜数千億パラメータ

- 数兆トークン規模の学習データ

- 巨大GPUクラスタによる学習

- 大規模分散計算

「Large」は単なるデータ量ではなく モデル規模・計算規模・学習規模を意味します。

トークン列としての言語

- 自然言語(日本語 / 英語など)

- コード(Python / JavaScriptなど)

- 数式・記号

- 論理的な構造

LLMは言葉を理解しているというより トークン列の関係性を学習しています。

Model(確率予測モデル)

Input tokens

↓

Embedding

↓

Transformer Layers

↓

Self Attention + Feed Forward

↓

Next Token Prediction

P(token_n | token_1 ... token_n-1)

03 — LLM Internal Process

LLMは魔法のAIではなく、内部では明確な処理パイプラインを持っています。 入力されたテキストはトークン化され、埋め込みベクトルへ変換され、 トランスフォーマーレイヤーを通じて処理された後、次トークンの確率が計算されます。

LLM Internal Pipeline

Input Text

↓

Tokenization

↓

Embedding

↓

Transformer Layers

↓

Self Attention

↓

Feed Forward Network

↓

Next Token Prediction

LLMの本質は Next Token Prediction です。

会話・文章生成・コード生成などは、

この予測処理が連続して実行されることで実現されています。

04 — LLM Access Architecture

LLMは同じモデルでも、どのアクセスレイヤーから利用するかによって 観測される挙動や利用パターンが変わります。 UI環境とAPI環境では、セッション構造・制御・利用目的が大きく異なります。

LLM Access Layer UI Access Free Plus Pro Team Enterprise API Access OpenAI API Gemini API Claude API

UIアクセス(Free / Plus / Pro / Team / Enterprise)は、 人間との対話を前提とした利用形態です。 文章作成、設計検討、コード生成など 思考プロセスを伴う作業に適しています。

実務では、長いセッションの中で 設計 → 検証 → 修正を繰り返すケースが多く、 Plus / Team / Enterprise のUI環境をチューニングして 利用する方が効率的な場合も少なくありません。

一方、API利用は 大量処理・自動処理・システム統合など 機械的処理に適した利用形態です。

UI → Thinking / Design / Generation API → Automation / System Integration

実務ではこの2つを分けて使うことで、 AIの能力を最も効率よく活用できます。

05 — SNS #31 要点整理

LLM(Large Language Model)の意味を整理すると、 AIの構造と限界が見えやすくなる。

#31|LLMとは何か? ― Large Language Model の本当の意味 1. LLMは巨大なニューラルネットワーク 膨大なデータで学習されたモデルであり、 トークン列を処理して出力を生成する。 2. Large ・数十億〜数千億パラメータ ・数兆トークン規模の学習 ・巨大GPUクラスタ 3. Language 自然言語だけではない ・テキスト ・コード ・数式 ・記号 ・論理 すべてトークン列として扱う。 4. Model LLMの本質は Next Token Prediction 入力されたトークン列から 次のトークンを確率的に予測する。 5. 結論 会話AIに見えても、 内部では 「次トークン予測」 が繰り返されている。 ここを理解すると 推論モデルの理解にもつながる。

06 — SNS #31 English Version

English summary of the core concept of Large Language Models.

#31 | What is LLM? — The real meaning of "Large Language Model" 1. LLM is a large neural network trained on massive datasets. It processes token sequences and generates the next token. 2. Large • billions to trillions of parameters • massive training datasets • large-scale GPU infrastructure 3. Language Language does not only mean human natural language. LLMs process token sequences such as: • text • code • mathematical expressions • symbols • logical structures 4. Model The core mechanism of LLMs is Next Token Prediction Given a sequence of tokens, the model predicts the most probable next token. 5. Conclusion What looks like conversation is actually a sequence of next-token predictions. Understanding this mechanism helps explain how reasoning models work.

LLMs are next-token prediction engines.