2つの統合型LLMが提示する「入り口(Gateway)」の規格

#31では、LLMそのものの正体を確認した。

#32では、それが単なるモデルではなく、UI・API・管理機能・周辺サービスまで含めた「統合型LLM」として提供されている現実を整理した。

そうすると次に問うべきは、性能比較ではない。

私たちは実際に、どの入口からその統合型LLMに触れているのか、である。

多くの人はAIを語るとき、すぐに回答精度やモデル性能の話に向かう。

しかし実務の現場で最初に見るべきなのは、対話UIなのか、APIなのか、あるいは業務環境に統合された機能なのかという「入口の構造」である。

入口が違えば、見える世界も、制御のしやすさも、障害時の影響も変わる。

現在、その入口の規格を強く提示しているのが、OpenAIのGPT系とGoogleのGemini系である。

この2者は単なるモデル差ではなく、管理、監視、可視化、エコシステム統合まで含めて異なる思想を持っている。

だから#33では、モデル名を比較するのではなく、まず「どの入口に立っているのか」を確認する。

ここを誤ると、その後のAI理解はすべてズレ始める。

高度に整備された開発エコシステム

統合型LLMにおいて、AIへの入口は大きく2つに分かれる。

それが対話UIとAPIである。

しかし実際の運用では、この2つの境界が必ずしも明確とは限らない。

GPTの場合、UIとAPIの関係が比較的整理されており、

ユーザー視点ではどちらも「同じ入口」に見える形で統合されている。

そのため、個人利用からシステム連携まで段階的に拡張しやすい。

一方でGeminiは、UI、API、Google Cloud(Vertex AI)が分散しており、

一見UIのように見える操作でも、実際にはクラウド設定や複数サービスの理解が必要になる。

そのため運用構造が分かりにくく、実務ではエンジニアリング負荷が高くなるケースが多い。

GPT系の強みは、単にモデル性能が高いことではなく、

こうした入口の整理と運用設計が比較的明確に提供されている点にある。

一方でGeminiは、Google CloudやWorkspaceとの統合を前提とした

クラウド中心のAIエコシステムとして設計されている。

UI・API・Vertex AIなど複数のサービスが分散しており、

Google環境との親和性は高いが、

構造全体を理解するにはクラウド設計の知識が必要になるケースも多い。

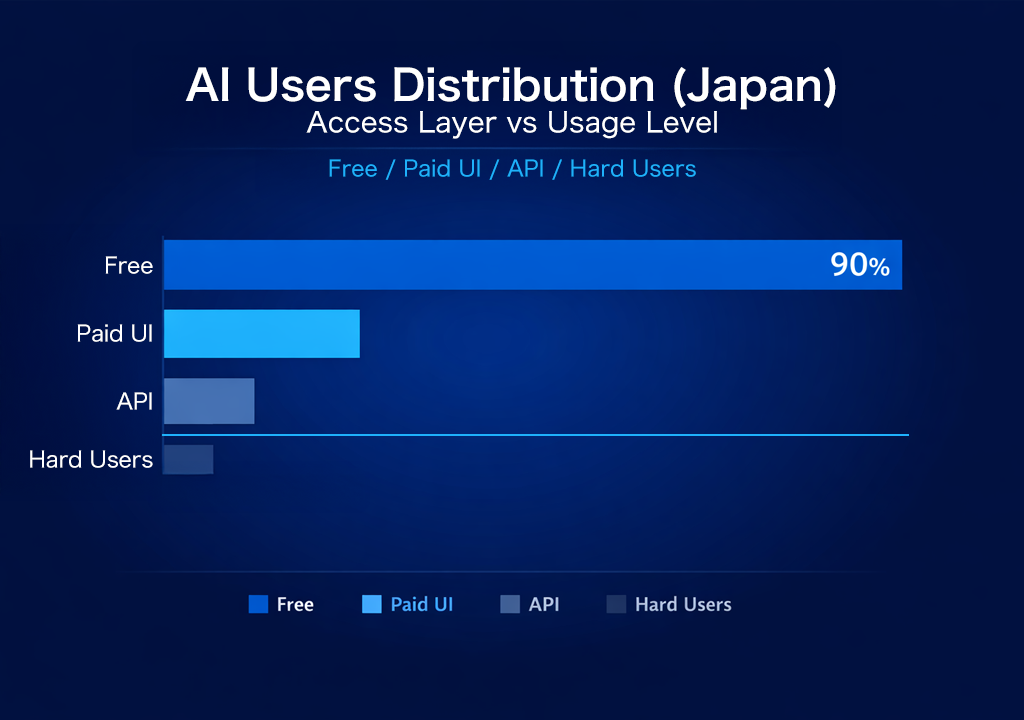

各プランのコスト構造

統合型LLMのコストを理解する際、まず注意すべきなのは

UIプランとAPIでは課金構造がまったく異なるという点である。

UIプランは基本的に月額固定であり、コストが読みやすい。

一方でAPIに入ると、課金はトークン量に応じた従量制になる。

実務レベルの利用では、開発・AI設計・継続対話などを行う

ハードユーザーの場合、月額コストは

$150〜$600程度に到達するケースも珍しくない。

このトークン量は非常に分かりにくく、

長時間の対話や大量のコード生成などを行うと消費量は急激に増える。

| サービス | プラン | 月額費用(目安) | 主なターゲット |

|---|---|---|---|

|

GPT (OpenAI) |

Plus / Team | $20〜$30 /人 | 個人 / 小規模チーム |

| Pro | $200 | 最優先リソースを求める層 | |

| Enterprise | $60〜 | 大規模法人 | |

| API(ハードユーザー実測) | $150〜$600 /月 | 開発 / AI設計 / 継続対話 | |

|

Gemini (Google) |

Advanced | 2,900円 | 個人ユーザー |

| Business | $20 /人 | ビジネス利用・管理機能 | |

| Enterprise | 約35,000円 | 最高位の法人プラン | |

| API(ハードユーザー実測) | $150〜$600 /月 | 開発 / AI設計 / 継続対話 |