File Format Strategy (RAG & Token Focus)

Geminiの100万トークンを超える圧倒的なコンテキスト窓は、数千ページのPDFや膨大な技術ドキュメントを「一括で」読み込む実務において無類の強さを発揮します。

対してGPTは、ファイルの「検索(Search)」と「抽出」のバランスに優れており、必要な箇所をピンポイントで特定する精度が高いのが特徴です。用途によって、全量を流し込むか、検索させるかの使い分けが重要になります。

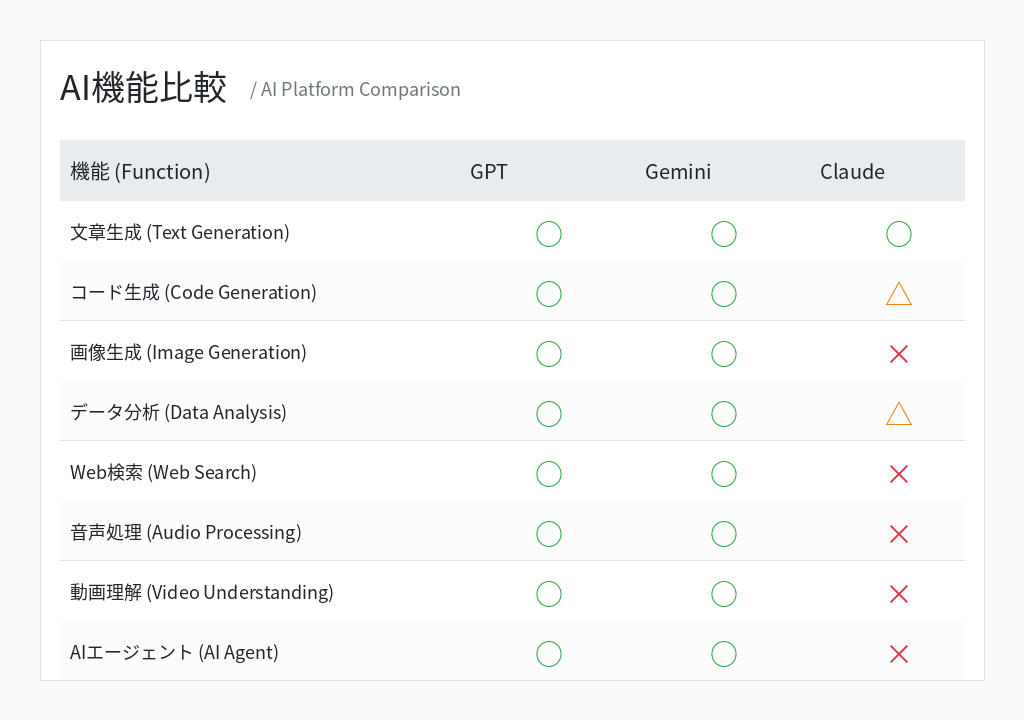

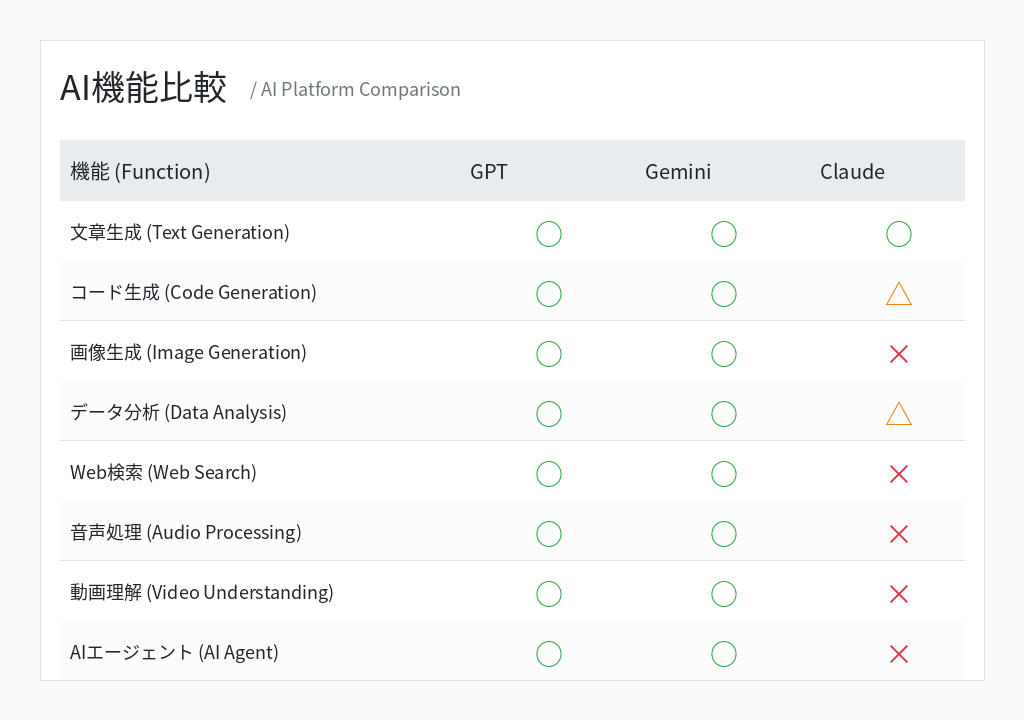

LLMは単体のモデルではなく、プラットフォームとして提供されています。

本ページでは GPT / Gemini / Claude の構造と実務適性を比較します。

#1から主に構造的に説明してきましたが、分かりにくいとお声を多くいただき、あらためて#28からは、より実務的、技術的な説明をするようにさせていただいております。また、前回 #31 では「LLMとは?」について説明しましたが、今回の #32 では「統合型LLMとは?」について、その構造と実務への影響を詳しく解説します。

前回の #31「LLMとは?」 では、 Large Language Model の基本構造について説明しました。

LLMは、大量のテキストデータを学習し、 自然言語を理解・生成するAIモデルです。

しかし、私たちが実際に利用しているAIサービスは、 LLM単体ではなく、 その上に構築された AIプラットフォーム として提供されています。

次に、その構造を見ていきます。

現在の生成AIは、単一のモデルではなく プラットフォームとして提供されています。

ユーザーは通常、 以下の2つのインターフェースを通して AIを利用します。

このように、AIサービスは LLMを中心としたプラットフォームとして 構築されています。

現在の主要なLLMサービスは 主に以下の3つに分類されます。

これらは同じLLM技術を基盤としていますが、 それぞれ異なるアーキテクチャと サービス戦略を持っています。

AIサービスを比較する際、 単純な性能比較だけでは 実際の利用価値は見えてきません。

本ページでは、 以下の観点から比較を行います。

これらの要素を比較することで、 実際の利用環境における AIの特性を明らかにします。

現在の主要なLLMサービスには GPT(OpenAI)、 Gemini(Google)、 Claude(Anthropic) の3つが存在します。

これらは同じLLM技術を基盤としていますが、 実際のサービス構造や機能には大きな違いがあります。

本ページでは、実際の利用環境における 機能 と 作業適性 の観点から、3つのAIを比較します。

AIを日常的な会話用途ではなく、 実務レベルの作業に利用するユーザーは ハードユーザーと呼ばれることがあります。

ハードユーザーの作業は、主に以下のような内容になります。

このような用途では、 AIの対応機能や処理範囲が 非常に重要な要素になります。

Geminiの100万トークンを超える圧倒的なコンテキスト窓は、数千ページのPDFや膨大な技術ドキュメントを「一括で」読み込む実務において無類の強さを発揮します。

対してGPTは、ファイルの「検索(Search)」と「抽出」のバランスに優れており、必要な箇所をピンポイントで特定する精度が高いのが特徴です。用途によって、全量を流し込むか、検索させるかの使い分けが重要になります。

COBOLやAssemblyといったレガシー言語の解析において、GPTの学習モデルの厚みは他を圧倒します。Geminiは長大なソースコードを一気に読み込めますが、ロジックの抽出精度ではGPTに分があります。

一方のClaudeは、複雑な構造解析において指示を勝手に「端折る」傾向が観測されます。特にレガシー特有の『泥臭い例外処理』や『複雑な条件分岐』を、最適化の名の下に省略・簡略化してしまうリスクがあり、これは変換後のシステムで原因不明の不整合を引き起こすトリガーとなります。一文字の欠落も許されない基幹系移行の実務において、たとえ無骨であっても全てのロジックを律儀に追い続けるGPTの『保守の誠実さ』こそが、信頼の差となっています。

長時間の連続作業や大規模プロンプトの処理において、Claudeは一貫性の欠如や「指示の省略(Omission)」が顕著になります。特にHTML生成やAI設計といった、厳密な構造維持が求められるタスクにおいて、この不確実性は致命的なリスクとなります。

特に、セッションが長引くほど『初期の制約条件』を維持できなくなる傾向があります。1,000行単位のコードを非破壊で保守し続けるには、文脈全体を統制する『一貫性のスタミナ』が不可欠ですが、Claudeは途中で独自の最適化(=構造破壊)を差し込んでしまうため、プロフェッショナルの現場での『完走』には適していません。

ハードユーザーの作業環境では、 Claudeは必ずしも最適とは言えないケースがあります。

筆者自身もClaudeを利用して 複数の検証を行いましたが、 特に以下のような作業では 制約が見られる場面がありました。

作業の途中で 「この作業はできません」 という回答が出るケースもあり、 実務用途では制約を感じる場面がありました。

一方で、Claudeにも多くの利点があります。

特に、長文の読解や文章生成では Claudeは非常に高い性能を持っています。

そのため、 用途によっては Claudeが最適なAIとなる場合もあります。

以上の比較から、 GPT と Gemini は統合型AIプラットフォーム として設計されています。

一方で Claude は高性能LLMサービス ではあるものの、 統合型AIプラットフォームという観点では GPT / Gemini と同じ構造ではありません。

以上の比較から、 現在の主要LLMサービスには GPT(OpenAI)、 Gemini(Google)、 Claude(Anthropic) の3つが存在します。

しかし、その機能構造や対応範囲には大きな違いがあります。

そのため本シリーズでは、 GPT / Gemini を統合型LLMとして扱い、 ClaudeはLLMサービスとして整理しています。

ここ数ヶ月、Gemini(およびそのAPI)において、プロフェッショナルの作業を根本から破壊する深刻な挙動が頻繁に発生しています。それは、「指示していない箇所を勝手に書き換える、あるいはロジックや数値を微変動させる」という、言語やインターフェースを問わない制御不能なクセです。

GPTでは、指示された範囲外を「触らない(Non-destructive)」という制御が極めて高い精度で保たれています。対してGeminiは、Google特有の「情報の最適化」という思想が仇となり、実務において不可欠な「現状維持の誠実さ」が欠落しています。

さらに、これらはチャットUIユーザーだけではなく、APIユーザーにも同様に起こる症状として確認されています。APIパラメータで temperature: 0 を指定しても、この確率的な「勝手な修正」というモデル固有のバイアスは抑制できず、自動化プロセスにおいてデバッグ不能な毒を混入させる致命的な欠陥となっています。

Geminiが「勝手な上書き」に走るのに対し、Claudeは「指示の省略(Omission)」という別の致命的な問題を抱えています。特に大規模なプロンプトや長時間のセッションにおいて、この傾向は顕著になります。

文章生成能力は高いものの、1文字の欠落も許されない基幹系移行や大規模開発において、Claudeの「横着」はサイレントな不整合を引き起こすトリガーとなります。完走能力と出力の安定性において、依然としてGPTとの間には越えられない壁が存在します。

本ページは AI構造シリーズの一部です。

AIの理解は、以下のページを順に読むことで

より体系的に理解できます。